В сети интернет распространяют фейковые видео с наложением лиц и голосов известных людей. Притом, делают это мошенники, которые с помощью новой уловки

- Последнее время на просторах интернета появилось относительно новое явление deep fake - это фейковые видео с наложением лиц и голосов известных людей на видео различного содержания с применением технологий Deep Learning (нейронных сетей). Эта технология позволяет заменить движения губ и речь человека на видео. Обычному пользователю довольно сложно определить подобные фейки, и многие принимают такие шутки за чистую монету, что, в свою очередь открывает широкие возможности для разного рода мошенников и провокаторов", - рассказали в компании "Инфосистемы Джет" РИА "Новости".

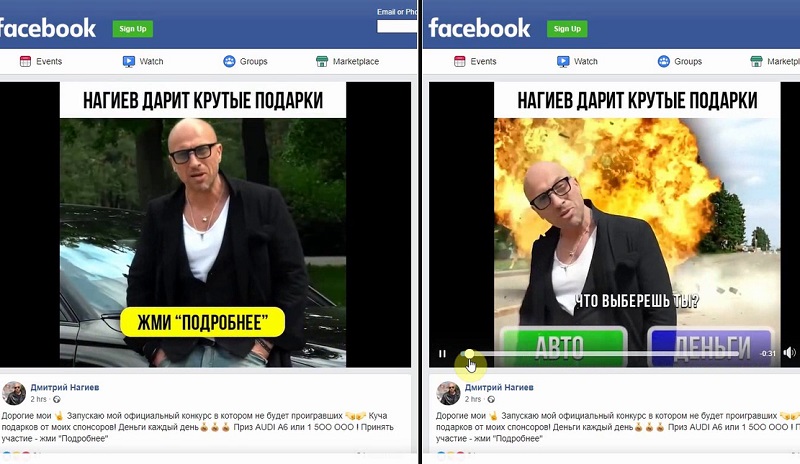

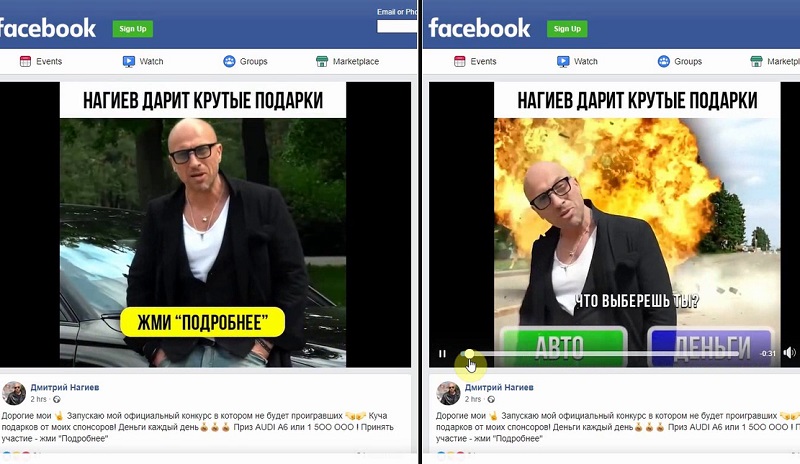

Специалисты компании обнаружили в сети мошенническое видео с использованием образа Дмитрия Нагиева, где он якобы обещает пользователям ценный приз или денежное вознаграждение – для этого лишь надо перейти на сайт. В результате это ведет к потере денег, отметили в компании.

При нажатии на ссылку пользователь попадает на портал со сгенерированным именем домена. Такие сайты обычно перестают отвечать через пару дней, потому что попадают в черные списки. Но злоумышленники запускают новые сайты и новую рекламу, поэтому пока сложно судить, сколько именно пострадало пользователей.

По словам специалиста по нейронным сетям компании "Инфосистемы Джет" Анны Олейниковой, deep fake является крайне серьезной угрозой. "Спектр зловредного применения deep fake и подобных технологий очень широк: шантаж, дискредитация медийных персон и политических деятелей, нечестная конкуренция в бизнесе и политике", - считает она.

Пользователи могут распознать такие фейки по ряду признаков: например, если на видео глаза не моргают, все время открыты или полузакрыты, то, скорее всего, это deep fake; резкие колебания четкости изображения; появление странных шлейфов вокруг контура головы при резких движениях, поворотах, наклонах; колебания освещенности и теней на лице, если положение лица относительно источника света не меняется и ряду других. Например, ранее в сети было распространено такое видео с "Киану Ривзом в магазине".

- Последнее время на просторах интернета появилось относительно новое явление deep fake - это фейковые видео с наложением лиц и голосов известных людей на видео различного содержания с применением технологий Deep Learning (нейронных сетей). Эта технология позволяет заменить движения губ и речь человека на видео. Обычному пользователю довольно сложно определить подобные фейки, и многие принимают такие шутки за чистую монету, что, в свою очередь открывает широкие возможности для разного рода мошенников и провокаторов", - рассказали в компании "Инфосистемы Джет" РИА "Новости".

Специалисты компании обнаружили в сети мошенническое видео с использованием образа Дмитрия Нагиева, где он якобы обещает пользователям ценный приз или денежное вознаграждение – для этого лишь надо перейти на сайт. В результате это ведет к потере денег, отметили в компании.

При нажатии на ссылку пользователь попадает на портал со сгенерированным именем домена. Такие сайты обычно перестают отвечать через пару дней, потому что попадают в черные списки. Но злоумышленники запускают новые сайты и новую рекламу, поэтому пока сложно судить, сколько именно пострадало пользователей.

По словам специалиста по нейронным сетям компании "Инфосистемы Джет" Анны Олейниковой, deep fake является крайне серьезной угрозой. "Спектр зловредного применения deep fake и подобных технологий очень широк: шантаж, дискредитация медийных персон и политических деятелей, нечестная конкуренция в бизнесе и политике", - считает она.

Пользователи могут распознать такие фейки по ряду признаков: например, если на видео глаза не моргают, все время открыты или полузакрыты, то, скорее всего, это deep fake; резкие колебания четкости изображения; появление странных шлейфов вокруг контура головы при резких движениях, поворотах, наклонах; колебания освещенности и теней на лице, если положение лица относительно источника света не меняется и ряду других. Например, ранее в сети было распространено такое видео с "Киану Ривзом в магазине".